AI 도입 후 GPU 청구서가 무서워졌다, 비용을 40~70% 줄이는 7가지 실전 액션

🤖 AI Summary

AI 모델을 운영하기 시작한 회사들이 첫 달 GPU 청구서를 받고 가장 많이 하는 말은 비슷합니다. 예상보다 두세 배 나왔다는 거죠. State of FinOps 2026 보고서(응답자 1,192명·830억 달러 클라우드 지출 대표)는 AI 토큰·추론·GPU 활용률 기반 가격 모델이 전통적인 빌링 프레임워크에 깔끔하게 매핑되지 않는다는 점을 핵심 챌린지로 꼽았습니다. 이 글에서는 GPU 비용 폭증의 구조적 원인을 짚고, 업계 분석에서 일관되게 보고된 40~70% 절감 가능한 7가지 실전 액션, 그리고 FinOps Foundation의 Inform-Optimize-Operate 단계별 적용 로드맵을 정리했어요.

블로그 목차

예상보다 청구서가 두세 배 나오는 진짜 이유

AI 모델을 도입한 첫 달 청구서를 받아본 회사들의 반응은 비슷합니다. 운영팀 시뮬레이션보다 두세 배가 나왔다는 거죠. 추론 트래픽이 예측을 빗나가고, GPU가 야간에도 켜져 있고, 인스턴스 타입을 잘못 골라서, 같은 이유들이 한꺼번에 누적된 결과입니다.

이게 우리 회사만의 특별한 문제는 아니에요. State of FinOps 2026 보고서는 응답자 1,192명, 연간 클라우드 지출 합계 830억 달러 규모의 데이터를 기반으로 AI 빌링 모델이 전통 인프라 비용 관리 체계에 잘 맞지 않는다는 점을 명시적으로 지적했습니다. 토큰·추론 요청·GPU 활용률 같은 단위가 기존 빌링 대시보드에 깔끔히 들어맞지 않는다는 거죠.

다행히 GPU 비용은 구조적으로 줄일 수 있는 영역이에요. 업계 분석들이 일관되게 보고하는 40~70% 절감이 가능한 7가지 액션과, FinOps Foundation의 단계별 적용 로드맵을 함께 정리했습니다.

왜 AI 비용은 기존 클라우드보다 통제가 어려운가

FinOps Foundation 공식 페이지는 AI 워크로드 비용이 전통 모델과 다른 이유를 세 가지로 정리합니다.

차이점 | 구체 내용 |

|---|---|

가격 변동성 | AI 모델·서비스는 버전과 변형마다 과금이 다르고, 가격이 위아래로 크게 흔들림 |

토큰이라는 새 단위 | 전통 인프라는 시간·트래픽·스토리지 단위지만 AI는 토큰 단위로 과금 |

GPU 자원 희소성 | GPU 기반 서버는 가용성과 인프라 자원이 항상 부족해 합리적 조달 자체가 어려움 |

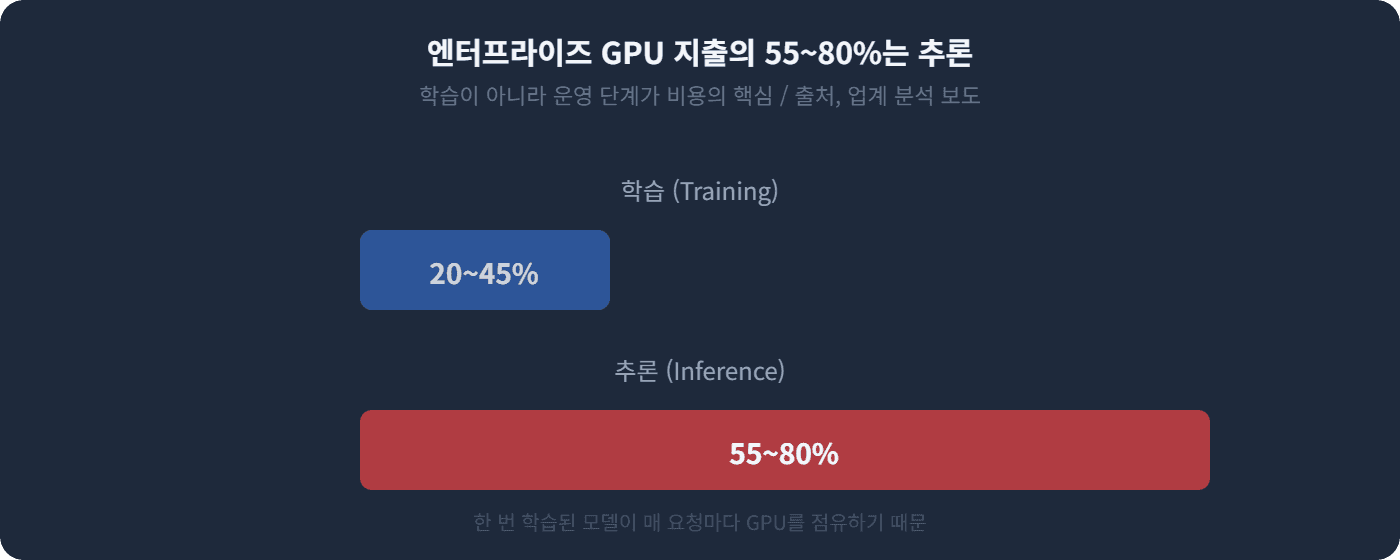

여기에 더해 추론(Inference)이 학습(Training)보다 비싼 시대가 됐습니다. 업계 분석들에 따르면 엔터프라이즈 GPU 지출의 55~80%가 추론에 쓰입니다(LeanOps, byteiota, Spheron 등 다수). 모델을 한 번 학습하면 끝나는 게 아니라 매 요청마다 GPU가 돌기 때문이죠.

이 구조 변화는 비용 절감 우선순위도 바꿔놨습니다. 학습 시점만 신경 쓰면 됐던 시대가 끝나고, 24시간 돌아가는 추론 인프라를 어떻게 효율화하느냐가 청구서를 결정하는 시대가 된 거죠.

GPU 청구서를 다이어트하는 7가지 실전 액션

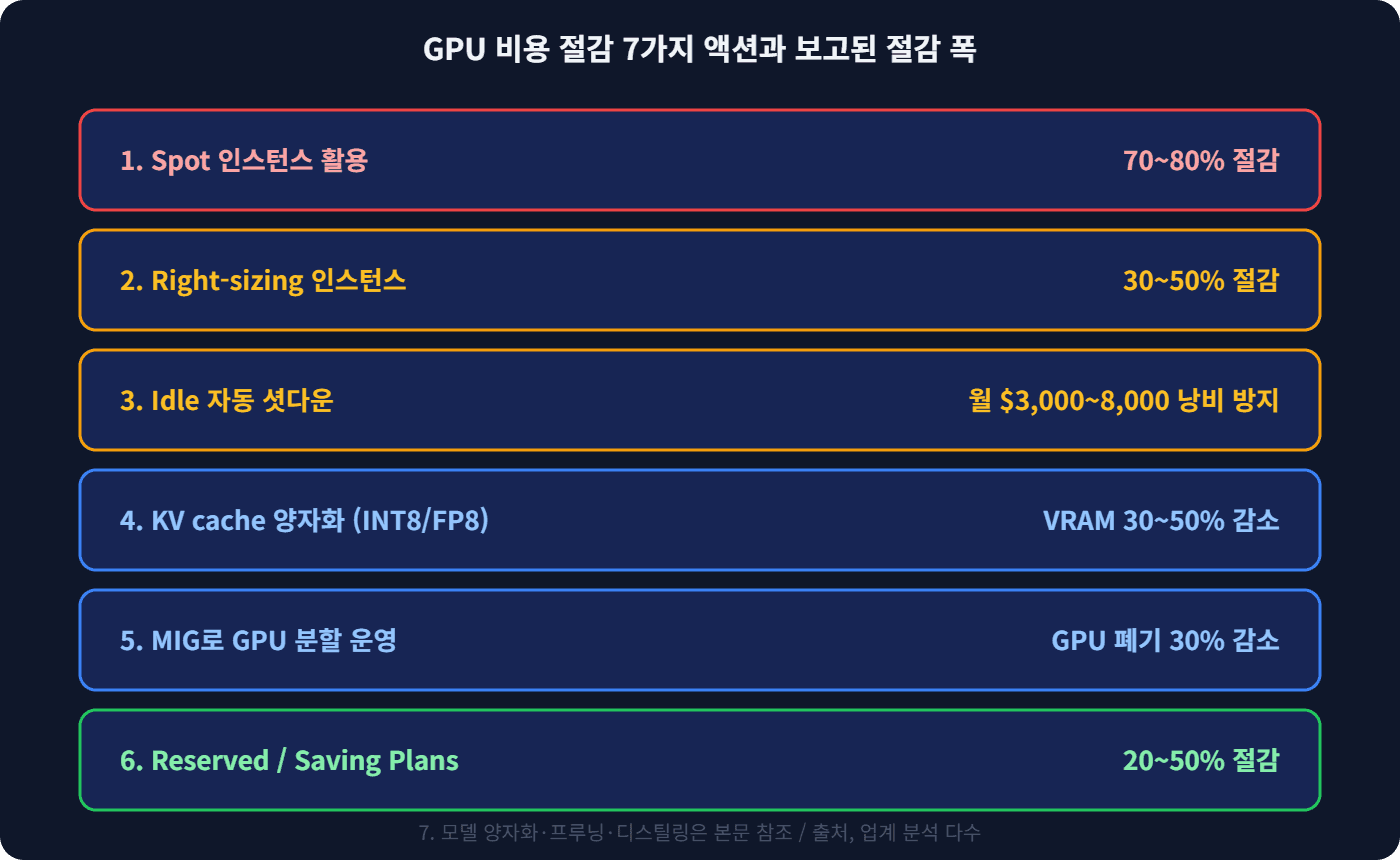

업계 분석들이 공통적으로 강조하는 7가지 액션을 효과 큰 순서로 정리했어요. 각 항목 옆에 보고된 절감 폭을 함께 적었습니다.

1. Spot 인스턴스 활용 (학습 단계 우선)

업계 분석에 따르면 GPU Spot 인스턴스는 On-demand 대비 70~80% 절감이 보고됩니다. 가격이 가장 큰 폭으로 빠지는 단일 액션이지만, 인스턴스가 회수될 수 있다는 점에서 체크포인팅(checkpointing) 설계가 필수예요. 학습 잡(Job)처럼 중단 가능한 워크로드부터 적용하고, 추론 트래픽이 안정적인 시간대에는 일부 추론에도 시도해볼 수 있습니다.

2. Right-sizing 인스턴스 (워크로드와 GPU 매칭)

실제 워크로드에 비해 과한 GPU를 쓰는 경우가 많아요. H100이 필요 없는 추론에 H100을 붙여놓거나, 메모리만 큰 인스턴스에 작은 모델을 돌리는 식이죠. GPU 타입을 워크로드 요구사항에 맞춰 다시 매핑하는 작업만으로 30~50% 절감이 보고됩니다(LeanOps).

3. Idle 자동 셧다운 (야간·주말 인스턴스 끄기)

업계 보도에 따르면 AWS p4d.24xlarge 인스턴스 한 대를 주말 48시간 켜둔 채 방치하면 약 1,573달러가 그대로 청구됩니다. 한 달에 야간·주말 idle이 누적되면 인스턴스당 3,000~8,000달러가 낭비될 수 있다는 분석도 있어요. 비활성 인스턴스를 자동으로 셧다운하는 정책 하나만 적용해도 즉각 효과가 큽니다.

4. KV cache 양자화 (추론 효율)

추론 단계에서 메모리 압박이 큰 경우 KV cache를 INT8 또는 FP8로 양자화하면 VRAM 사용량을 30~50% 줄일 수 있습니다. 같은 GPU에서 더 많은 동시 요청을 처리할 수 있게 되니까 결과적으로 같은 처리량을 더 적은 GPU로 감당하게 되죠. 32K 이상의 긴 컨텍스트를 다루는 워크로드일수록 효과가 큽니다.

5. MIG로 GPU 분할 운영

NVIDIA A100·H100은 Multi-Instance GPU(MIG) 기능으로 한 장의 GPU를 더 작은 독립 단위로 쪼갤 수 있습니다. 작은 모델 여러 개를 병렬로 돌릴 때 한 GPU를 통째로 점유하는 대신 분할 사용하면 GPU 폐기(낭비)가 약 30% 줄어든다는 분석이 있어요(byteiota). 워크로드가 GPU 한 장을 다 쓰지 못하는 경우 가장 직접적인 해결책이죠.

6. Reserved / Saving Plans 혼합

장기 안정 트래픽 부분은 Reserved 또는 Saving Plans로 1~3년 약정해 20~50% 절감을 받고, 변동 트래픽은 On-demand나 Spot으로 처리하는 혼합 구조가 표준입니다. 모든 GPU를 Reserved로 묶는 건 위험하고, 모두 On-demand로 두는 건 낭비라는 거죠.

7. 모델 양자화·프루닝·디스틸링

마지막은 모델 자체를 가볍게 만드는 접근이에요. INT8/INT4 양자화, 프루닝(불필요한 가중치 제거), 디스틸링(작은 모델로 큰 모델 흉내내기) 같은 기법을 적용하면 같은 작업을 더 작은 GPU로 처리할 수 있습니다. ML 엔지니어링 자원이 필요해 즉시 적용은 어렵지만 장기적으로는 가장 큰 구조 개선이 됩니다.

FinOps Foundation의 단계별 적용 로드맵

액션 7가지를 한꺼번에 도입하는 건 현실적으로 어렵죠. FinOps Foundation은 AI 비용 관리를 단계적으로 정착시키는 Crawl-Walk-Run 접근을 권장합니다. 핵심 KPI 6가지(Cost Per Inference, Training Cost Efficiency, Token Consumption Metrics, Resource Utilization Efficiency, ROI, Cost per API Call)를 먼저 측정 가능하게 만든 뒤 단계적으로 최적화에 들어가는 방식이에요.

단계 | 핵심 활동 | 이번 분기 목표 |

|---|---|---|

1단계 Inform (가시화) | 모델·팀·환경별 비용 태깅, Cost Per Inference 대시보드 구축 | "우리가 GPU에 얼마 쓰고 있나" 답할 수 있는 상태 |

2단계 Optimize (효율화) | Right-sizing·Spot·Idle 셧다운·MIG 분할 적용, 모델 양자화 검토 | 분기 단위 30% 이상 절감 달성 |

3단계 Operate (운영) | 주간 anomaly 리뷰, 월간 forecast vs actual 비교, 분기별 약정 재평가 | 비용 거버넌스가 일상 운영 리듬에 통합된 상태 |

중요한 건 1단계 가시화 없이 2단계 효율화로 바로 점프하지 않는 거예요. 어디에 얼마 쓰는지 모르는 상태에서 절감 액션을 적용하면 효과 측정이 안 되니까요. 외부 전문가와 함께 우리 회사 인프라에 맞춘 단계 설계를 하고 싶다면 스피디 MSP의 클라우드 비용 진단을 활용해보세요.

이것만 기억하세요

AI 워크로드 비용은 토큰·추론·GPU 활용률이라는 새 단위 때문에 전통 빌링으로 통제가 어렵고, 엔터프라이즈 GPU 지출의 55~80%가 추론에 쓰이는 시대로 바뀌었습니다. Spot 인스턴스, Right-sizing, Idle 셧다운, KV cache 양자화, MIG 분할, Reserved 혼합, 모델 경량화 등 7가지 액션을 조합하면 업계 분석에서 40~70% 절감이 일관되게 보고돼요. 한꺼번에 도입하기보다 FinOps Foundation의 Inform → Optimize → Operate 순으로 가시화부터 정착시키는 것이 현실적인 출발점입니다.

자주 묻는 질문 (FAQ)

Q. Spot 인스턴스가 70~80% 싸다는데 회수 위험은 어떻게 관리하나요?

Spot 인스턴스 활용의 핵심은 체크포인팅 설계입니다. 학습 잡이 일정 간격마다 모델 상태를 디스크에 저장하도록 구현하면 인스턴스가 회수돼도 다른 인스턴스에서 마지막 체크포인트부터 재개할 수 있습니다. 추론 트래픽처럼 즉시성이 중요한 경우에는 On-demand나 Reserved를 베이스로 깔고 피크 부하만 Spot으로 처리하는 혼합 구조를 권장합니다.

Q. KV cache 양자화는 모델 품질에 영향이 없나요?

INT8 양자화는 대부분 모델에서 품질 저하가 거의 없는 수준이고, FP8은 더 보수적인 방식이라 품질 영향이 미미합니다. 다만 INT4까지 가면 일부 작업에서 정확도 저하가 보고되니 도입 전 자사 워크로드에 대한 A/B 비교 테스트가 필수입니다. vLLM, HuggingFace TGI 같은 추론 프레임워크가 양자화 옵션을 기본 제공하므로 도입 자체는 어렵지 않습니다.

Q. MIG는 모든 GPU에서 쓸 수 있나요?

NVIDIA A100과 H100, 그리고 H200·B200 같은 데이터센터급 GPU에서 지원됩니다. 컨슈머 GPU(예: RTX 시리즈)나 일부 구형 GPU는 MIG 미지원이라 분할 운영이 불가능합니다. MIG는 GPU를 작게 쪼개기 때문에 대형 모델 단일 워크로드에는 오히려 부적합하고, 작은 모델 여러 개나 다수 사용자에 한 GPU를 분배할 때 효과가 큽니다.

Q. Reserved를 너무 많이 묶으면 위험하지 않나요?

그래서 혼합 비율 설계가 중요합니다. 일반적으로 1년 평균 사용량의 50~70% 정도까지만 Reserved 또는 Saving Plans로 잠그고, 나머지는 On-demand와 Spot으로 처리하는 방식이 표준이에요. 트래픽이 급감하더라도 약정 분량은 어차피 사용 가능 범위 안에 있도록 보수적으로 잡는 게 안전합니다. 분기마다 사용 패턴 변화를 보고 약정 재평가하는 습관도 필요합니다.

Q. 우리는 SaaS API(예: ChatGPT API)만 쓰는데 GPU FinOps가 필요한가요?

직접 GPU를 사지 않더라도 토큰 단위 과금은 동일한 비용 통제 문제를 일으킵니다. 모델·팀·기능별 토큰 사용량 태깅, 캐싱 가능한 응답 식별, 프롬프트 길이 최적화 같은 액션들이 GPU FinOps와 같은 원리로 작동해요. State of FinOps 2026 보고서도 SaaS형 AI 비용 관리를 핵심 챌린지 중 하나로 다루고 있습니다.