AI 크롤러가 CDN 비용을 폭증시키는 이유! 2026 봇 트래픽 대응 가이드

🤖 AI Summary

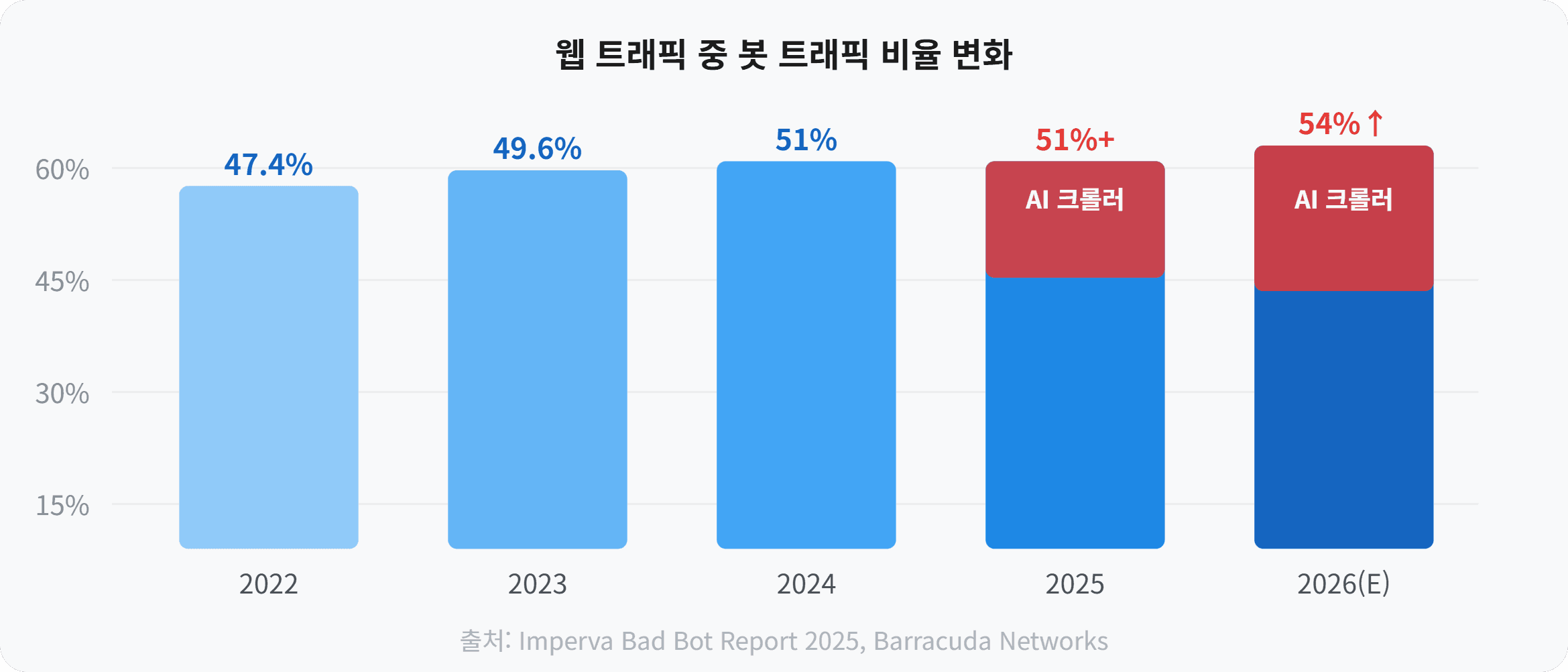

2026년 전체 웹 트래픽의 51%가 봇 트래픽이며, GPTBot·ClaudeBot 등 AI 크롤러가 CDN 대역폭 비용을 최대 40%까지 끌어올리고 있습니다. robots.txt 차단만으로는 모든 AI 크롤러를 막을 수 없고, CDN 레벨의 봇 관리 + WAF 규칙 + 실시간 트래픽 모니터링을 조합해야 합니다. 이 글에서는 AI 크롤러의 비용 영향을 데이터로 분석하고, 즉시 적용 가능한 5단계 대응 전략을 제시합니다.

블로그 목차

CDN 청구서가 갑자기 40% 올랐다면, AI 크롤러를 의심하세요

매달 비슷하던 CDN 비용이 어느 날 갑자기 40% 뛰어오른 경험, 혹시 있으신가요? 트래픽이 늘었나 싶어 확인해보면 실제 사용자 수는 변함이 없습니다. 이벤트도 없었고, 마케팅 캠페인도 진행하지 않았는데 말이죠.

범인은 AI 크롤러입니다. ChatGPT를 만든 OpenAI의 GPTBot, Anthropic의 ClaudeBot, Google의 Gemini 크롤러까지 — 2025년 하반기부터 AI 크롤러 트래픽이 폭발적으로 증가하면서, CDN 비용을 예상치 못하게 끌어올리는 기업들이 늘어나고 있습니다.

Imperva 2025 보고서에 따르면, 전체 웹 트래픽의 51%가 봇 트래픽이며 이 중 AI 크롤러 비중이 전년 대비 3배 이상 증가했습니다. 더 큰 문제는 이 트래픽이 대부분 CDN 캐시를 우회하거나, 대량의 API 요청을 발생시켜 오리진 서버 부하와 대역폭 비용을 동시에 올린다는 점입니다.

AI 크롤러, 기존 검색엔진 봇과 뭐가 다른가요?

Googlebot이나 Bingbot 같은 전통적인 검색엔진 크롤러도 트래픽을 발생시키지만, 대부분의 기업이 이 비용을 감수해왔습니다. 검색 노출이라는 확실한 보상이 있었으니까요.

하지만 AI 크롤러는 근본적으로 다릅니다.

구분 | 검색엔진 크롤러 | AI 크롤러 |

|---|---|---|

목적 | 검색 인덱싱 → 트래픽 유입 | LLM 학습 데이터 수집 → 보상 없음 |

요청 패턴 | robots.txt 준수, 점진적 크롤링 | 대량 병렬 요청, 캐시 무시 경향 |

대역폭 영향 | 예측 가능한 수준 | 오리진 직접 접근으로 비용 급증 |

User-Agent 식별 | 표준화, 잘 알려짐 | 변경 빈번, 위장 사례 존재 |

비즈니스 가치 | SEO 순위 → 매출 기여 | 직접적 가치 없음 (기업 입장) |

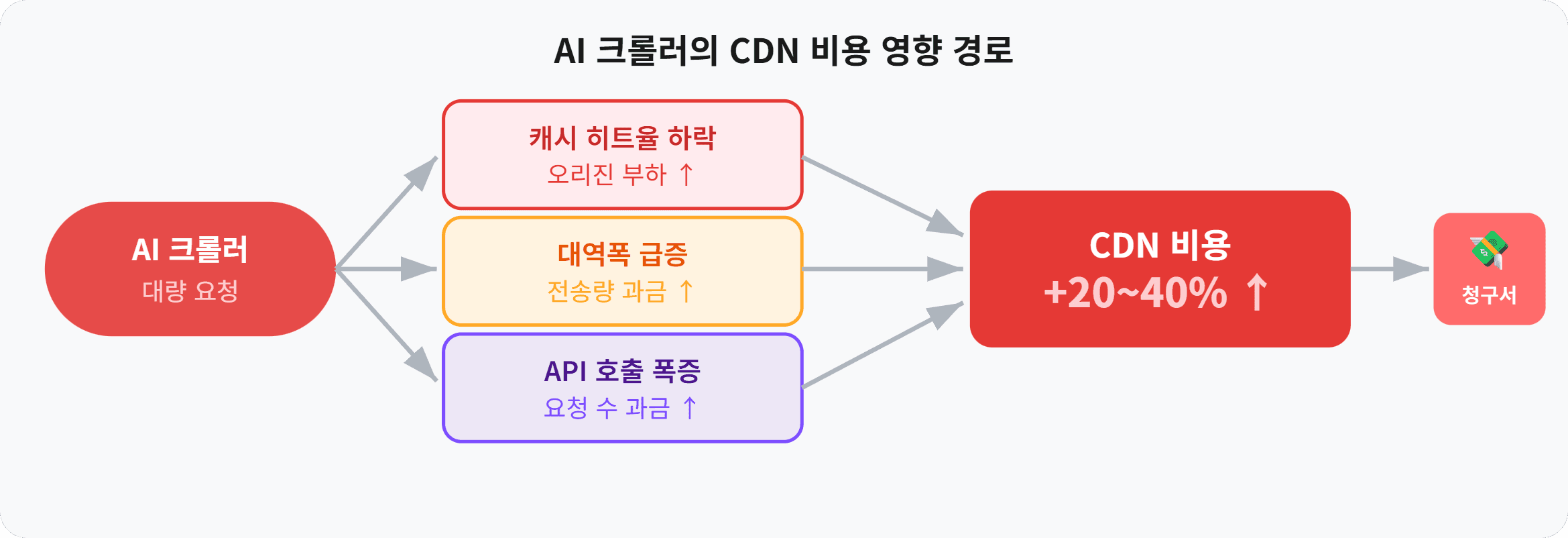

핵심 문제는 CDN 비용 구조에 있습니다. 대부분의 CDN은 전송량(대역폭) 기반으로 과금합니다. AI 크롤러는 페이지를 반복적으로, 대량으로 긁어가면서 대역폭 사용량을 끌어올립니다. 더구나 캐시 히트율이 낮은 동적 콘텐츠나 API 엔드포인트까지 무차별적으로 접근하기 때문에, 오리진 서버 트래픽까지 증가시킵니다.

DoubleVerify 분석에 따르면, AI 크롤러로 인한 가짜 트래픽(GIVT)이 2024년 대비 86% 증가했으며 이 트래픽의 상당 부분이 CDN 대역폭 비용에 직접 반영됩니다.

AI 크롤러가 CDN 비용을 올리는 3가지 메커니즘

1. 캐시 우회 — 오리진 직접 타격

AI 크롤러는 콘텐츠를 최신 상태로 수집하기 위해 캐시를 우회하는 요청 패턴을 보입니다. 쿼리 스트링을 변경하거나, 캐시 관련 헤더를 조작하여 CDN 엣지가 아닌 오리진 서버에 직접 요청을 보냅니다. 이는 CDN의 캐시 히트율을 떨어뜨리고, 오리진 트래픽 비용을 증가시킵니다.

2. 대량 병렬 요청 — 대역폭 급증

전통적인 크롤러가 예의 바르게 요청 간격을 두는 반면, 일부 AI 크롤러는 수십 개의 동시 연결로 페이지를 병렬 수집합니다. 중간 규모 웹사이트 기준, AI 크롤러 한 종류만으로 일일 대역폭이 50~200GB 추가 발생하는 사례가 보고되고 있습니다.

3. 전체 사이트 스크래핑 — 불필요한 리소스 소비

검색엔진 봇은 사이트맵 기반으로 필요한 페이지만 효율적으로 수집합니다. 반면 AI 크롤러는 모든 페이지, 이미지, PDF, 첨부파일까지 무차별적으로 긁어갑니다. 특히 이미지와 PDF는 파일 크기가 커서 대역폭 비용에 직접적인 영향을 줍니다.

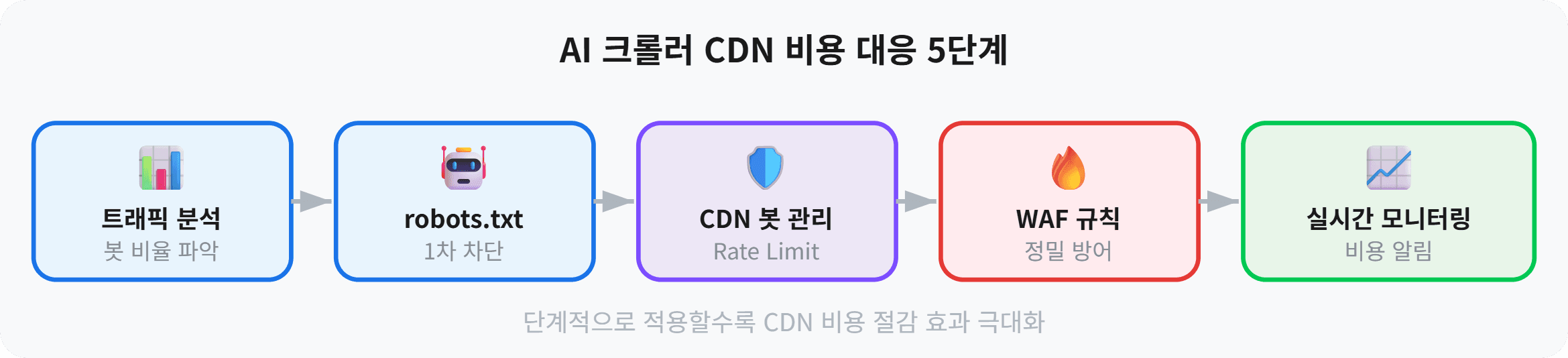

AI 크롤러 CDN 비용 대응, 5단계 실무 전략

1단계: 현황 파악 — 봇 트래픽 분석부터

대응의 첫걸음은 현재 얼마나 많은 AI 크롤러 트래픽이 발생하고 있는지 파악하는 것입니다.

CDN 액세스 로그에서 User-Agent별 요청 수와 대역폭을 집계하세요

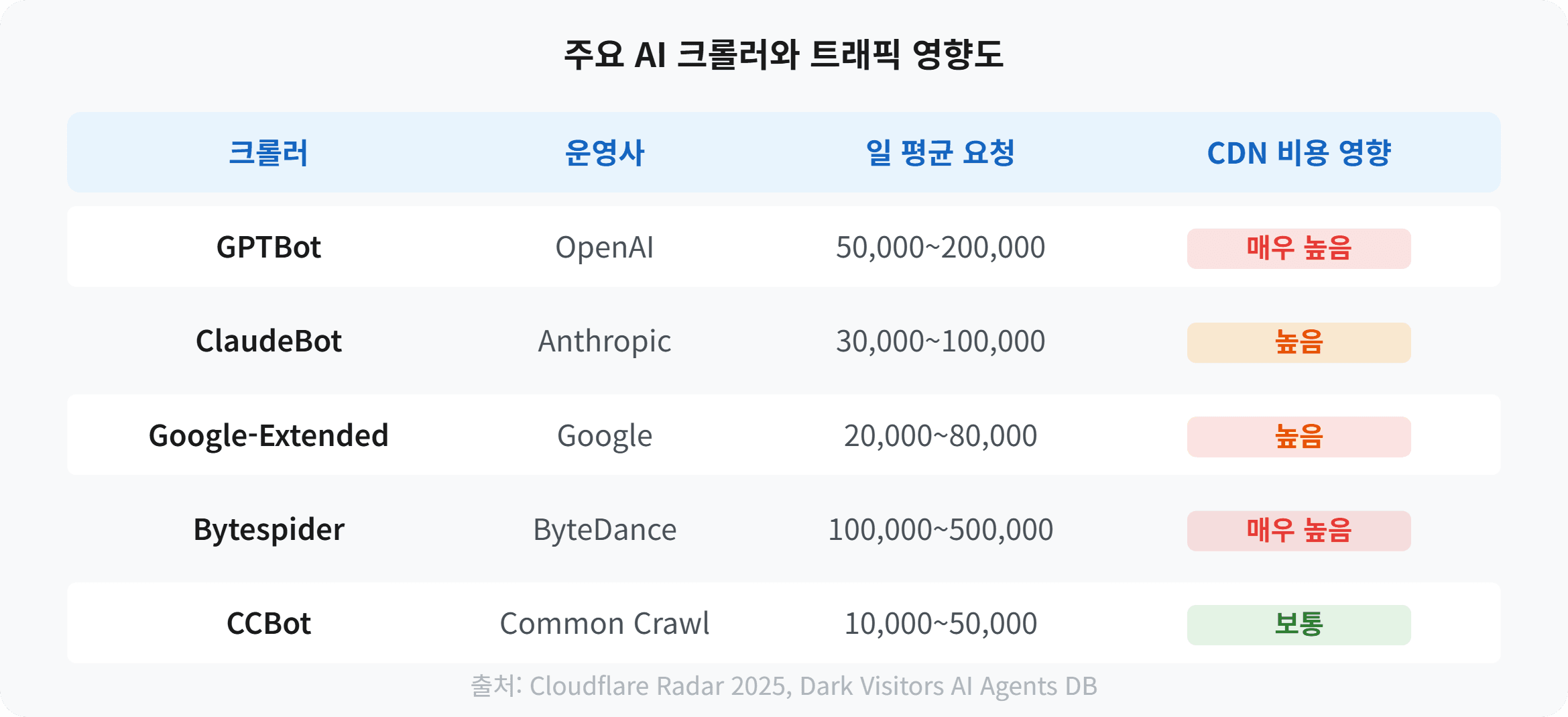

GPTBot, ClaudeBot, Bytespider, Google-Extended, CCBot 등 주요 AI 크롤러 User-Agent를 필터링하세요

전체 트래픽 대비 봇 트래픽 비율, 오리진 히트 비율을 확인하세요

시간대별 패턴을 분석하면 크롤러의 집중 접속 시간대를 알 수 있습니다

2단계: robots.txt — 기본이지만 완벽하지 않은 방어선

가장 먼저 할 수 있는 조치는 robots.txt로 AI 크롤러를 차단하는 것입니다.

robots.txt 설정 예시

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: Bytespider

Disallow: /

User-agent: Google-Extended

Disallow: /

하지만 robots.txt는 권고사항일 뿐입니다. 악의적인 크롤러나 User-Agent를 위장한 봇은 이를 무시합니다. 따라서 robots.txt는 1차 방어선이지, 유일한 대책이 되어서는 안 됩니다.

3단계: CDN 레벨 봇 관리 규칙 설정

CDN 서비스에서 제공하는 봇 관리(Bot Management) 기능을 활용하세요.

Rate Limiting: 동일 IP에서 분당 요청 수를 제한 (예: 분당 60건)

User-Agent 기반 차단: 알려진 AI 크롤러 User-Agent를 CDN 레벨에서 403 응답

Challenge 페이지: 의심스러운 봇에게 JavaScript 챌린지를 발행하여 자동화 도구 차단

지역 기반 제한: AI 크롤러가 주로 사용하는 데이터센터 IP 대역 제한

4단계: WAF 규칙으로 정밀 방어

WAF(Web Application Firewall)에 AI 크롤러 전용 규칙을 추가하면 더 정밀한 제어가 가능합니다.

User-Agent에 GPTBot, ClaudeBot, Bytespider 등이 포함된 요청 차단

비정상적인 요청 빈도(초당 10건 이상) 탐지 및 자동 차단

특정 경로(예: /api/, /data/)에 대한 봇 접근 제한

알려진 AI 크롤러 IP 대역(AWS, GCP 등 클라우드 IP) 모니터링

5단계: 실시간 모니터링 & 비용 알림 설정

AI 크롤러 트래픽은 예고 없이 급증합니다. CDN 대역폭이 평소 대비 20% 이상 증가하면 즉시 알림을 받을 수 있도록 모니터링 임계치를 설정하세요.

CDN 대시보드에서 실시간 대역폭 모니터링 대시보드 구성

일일 비용 임계치 초과 시 Slack/이메일 알림 설정

주간 봇 트래픽 리포트 자동 생성으로 추세 파악

새로운 AI 크롤러 User-Agent 등장 시 즉시 업데이트

AI 크롤러 대응 시 흔히 하는 실수 3가지

실수 1: robots.txt만 설정하고 안심하기

robots.txt는 협조적인 봇에게만 효과가 있습니다. User-Agent를 위장하거나 robots.txt를 무시하는 크롤러에는 CDN/WAF 레벨 차단이 필수입니다.

실수 2: 모든 봇을 무차별 차단하기

Googlebot, Bingbot 같은 검색엔진 크롤러까지 차단하면 SEO 순위가 급락합니다. AI 크롤러만 선별적으로 차단해야 합니다. 차단 전에 반드시 User-Agent 목록을 정리하고, 허용 목록(allowlist)을 먼저 만드세요.

실수 3: 한 번 설정하고 방치하기

AI 크롤러는 매달 새로운 종류가 등장하고 있습니다. 2025년 기준 Dark Visitors DB에 등록된 AI 크롤러만 100종 이상입니다. 분기별로 크롤러 목록을 업데이트하고, 로그를 주기적으로 분석해야 합니다.

자주 묻는 질문(FAQ)

Q. AI 크롤러를 차단하면 ChatGPT나 Claude에서 우리 사이트 정보가 안 나오나요?

이미 학습이 완료된 데이터에는 영향이 없습니다. 차단은 향후 추가 학습 데이터 수집을 막는 것입니다. 대부분의 기업에게 AI 크롤러 차단으로 인한 비즈니스 손실은 없습니다.

Q. AI 크롤러 때문에 CDN 비용이 얼마나 늘어나나요?

사이트 규모와 콘텐츠 양에 따라 다르지만, 월 CDN 비용의 20~40%가 AI 크롤러 트래픽으로 인한 추가 비용이라는 보고가 일반적입니다. 대형 미디어 사이트는 50% 이상 증가 사례도 있습니다.

Q. CDN 서비스마다 봇 관리 기능이 다른가요?

네, 상당히 다릅니다. Cloudflare는 무료 플랜에서도 기본 봇 관리를 제공하지만, AWS CloudFront는 별도의 AWS WAF 설정이 필요합니다. CDN 선택 시 봇 관리 기능을 반드시 비교하세요.

Q. robots.txt를 무시하는 AI 크롤러는 법적으로 문제가 되나요?

현재 법적 회색지대입니다. 2024년 뉴욕타임스 vs OpenAI 소송이 진행 중이며, 일부 국가에서는 robots.txt 무시를 불법으로 판단한 사례가 있습니다. 하지만 법적 대응보다 기술적 차단이 실무적으로 더 효과적입니다.

Q. 스피디에서 AI 크롤러 CDN 비용 최적화를 도와줄 수 있나요?

네, 스피디는 S-CDN과 멀티 CDN 관리 경험을 바탕으로 봇 트래픽 분석, CDN 비용 최적화, WAF 규칙 설정까지 원스톱으로 지원합니다.

이것만 기억하세요

AI 크롤러는 CDN 비용의 숨은 폭탄입니다. robots.txt 하나로 끝내지 마세요. 트래픽 분석 → robots.txt → CDN 봇 관리 → WAF 규칙 → 실시간 모니터링, 이 5단계를 순서대로 적용하면 AI 크롤러로 인한 CDN 비용 증가를 80% 이상 차단할 수 있습니다.